生成AIブームの目下、AI関連企業に熱い視線が注がれている。莫大な資金が集まるAI市場だが、AI企業が抱えるリスクももちろんある。市場をけん引するAI企業8社、GAFAM(アルファベット、アップル、メタ、アマゾン、マイクロソフト)と半導体主要3社(エヌビディア、AMD、ASML)が抱えるリスクをまとめた。

ESGリスク評価がAI投資家にもたらす効果

AIは投資家にとって強力なツールとなり得るもので、テーマについて学ぶことで大量のデータを選別し、比較する能力をもたらし、その速度は大半の人間を上回る。私たちはこれまでにもAI重視の投資家が検討すべき成熟分野として半導体業界を取り上げており、最近では、ESG(環境、社会、ガバナンス)重視の投資家にとってAIがどのように貢献し、あるいは妨げとなるのかについて考察している。

しかし、AIは万能薬ではない。ESGの観点からは危険が存在する。この種のリスクに対する理解を深めるために、調査会社サステナリティクスのESGリスク評価とその管理要素を活用することで、半導体とソフトウェア、それぞれの業界でどの企業がAIをリードする存在として将来起こり得る論争を回避できるポジションにあるかを判断することができる。

特に、「重要ESG課題」(material ESG issues:MEI)の管理を見れば、AIが中心となる未来をうまく乗り切るのに最適なポジションにあるのはどの企業なのかが理解しやすくなる。重要課題に含まれるのは、ビジネス倫理、自社業務によるカーボン排出、データプライバシーおよびセキュリティ、製品ガバナンスである。

企業価値評価についても検討したうえで明らかになったのは、マイクロソフト、アドバンスト・マイクロ・デバイセズ(AMD)、ASMLホールディングがAIをチャンスにできる企業の上位に浮上する一方で、アマゾンとメタが魅力に乏しい現在の株価も相まって、大きなESGリスクを抱えていることである。

GAFAM・エヌビディア・AMD・ASMLのESGリスク評価一覧表

ESG管理が他社より優れている大手AI企業もある

(出典:米モーニングスター、サステナリティクス。2023年10月9日時点のデータ)

注意点をいくつか挙げておこう。ここで示すデータは評価であり、必ずしも予測ではない。また、ここで挙げる企業の現在の(そしておそらく今後当面の)収益のうち、AIが占める割合はごくわずかだ。

とはいえ、課題の管理が適切でなければ将来のキャッシュフローに深刻な財務的損害が生じる可能性があることを考えれば、AI重視の投資家にとってはこれらの企業が直面する主要ESGリスクを理解することが重要になる。

AIが“自ら”語ったESGリスクとは

誰かを批判するとき、自身を弁護する機会を与えるのは当然のことだと思われる。私たちは、ESGリスクについてAIに直接聞いてみた。

OpenAIのGPT-4を使用しているBing Chatは、指示されれば、AIのいくつかの主要ESGリスクの概要を説明し、背景情報として関連する記事や調査のリンクを提供するという作業を非常にうまく実行する。

質問:

AIのESGリスクとは?

Bing Chatによる回答:

AI関連のESG(環境、社会、ガバナンス)リスクに対する懸念が高まっている。主要リスクをいくつか以下に示す。

1)環境への影響:

AIシステムは大規模ニューラル・ネットワークのトレーニングに大量のコンピューティング能力を必要とするため、持続可能性目標に対する重大な脅威となる可能性がある。データの保存と処理による二酸化炭素排出量は膨大かつ増加傾向にある。2)社会リスク:

AIシステムによって人種的不平等が恒久化し、民主主義プロセスに混乱が生じる可能性があることが判明している。AIシステムによって個人が公平に扱われるかどうか、また、従来の社会的不平等が再現あるいは増幅されるのではないかという懸念もある。3)ガバナンスリスク:

経営陣も一般従業員もテクノロジースキルが不足しており、企業がミスを犯しやすくなる可能性がある。アルゴリズムの偏り、AIに仕事を奪われる恐れ、説明責任、データプライバシー、信頼性などの問題も重大な懸念事項である。

AIシステムの導入に際し、これらのリスクを認識し、責任あるAIの開発、調達、利用の実践に努めることが投資家と企業には求められる。

日本ではあまり語られない「環境」リスクとは

Bing Chatが提示した喫緊のESG課題の中でも、AI関連の「環境」に対する懸念は、間違いなく最上位に位置づけられるものだ。

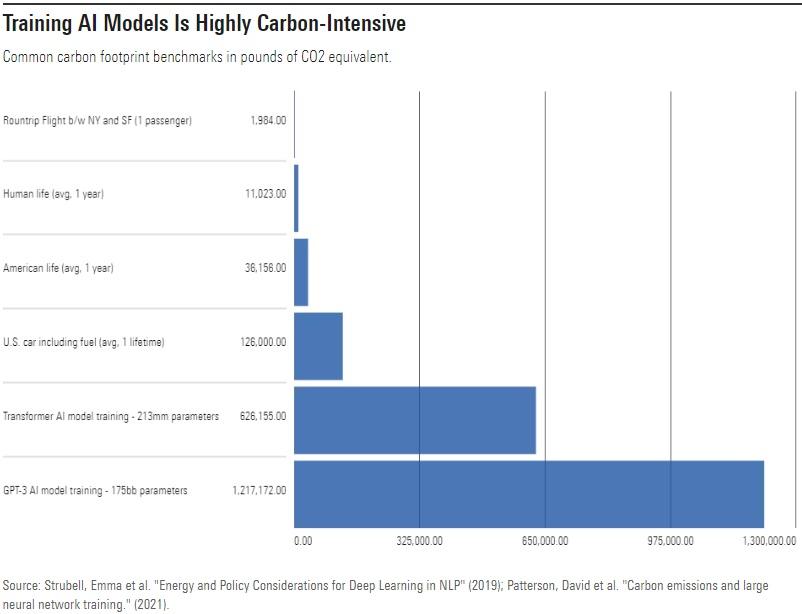

MITの2019年の調査によると、たとえば、当時の大規模AIモデルのトレーニングでは、米国の平均的な自動車が耐用期間中に排出する二酸化炭素量の約5倍が排出される可能性があることが明らかになった。そして、この数値はその後増加傾向にある。2021年の調査では、OpenAIのGPT-3のトレーニングの二酸化炭素強度はほぼ2倍と推定されている。

二酸化炭素排出量の比較評価基準(CO2換算ポンド単位)。上から、「ニューヨーク-サンフランシスコ間往復飛行(乗客1名)」「人間の生活(1年間平均)」「米国人の生活(1年間平均)」「燃料を含む米国車(1耐用期間平均)」「Transformer AIモデルのトレーニング-213mmパラメータ」「GPT-3 AIモデルのトレーニング-175bbパラメータ」。AIモデルのトレーニングは二酸化炭素を大量消費することがわかる

(出典:「NLPにおけるディープラーニングのエネルギーと政策の考慮事項」エマ・ステューベル他(2019年)、「カーボン排出と大規模ニューラル・ネットワークのトレーニング」デヴィッド・パターソン他(2021年))

しかしBing Chatは、AI固有の偏り、雇用の喪失、企業のシニアリーダーに求められる管理といった「社会」および「ガバナンス」の問題も指摘している。

サステナリティクスのESGリスク評価の管理要素からは、いくつかのインサイトが得られる。サステナリティクスは個々のMEIを対象に、各企業にWeak/Average/Strongの管理スコアを割り当てている。AIの場合、上記の問題との関連度が最も高いMEIは、ビジネス倫理、自社業務によるカーボン排出、製品ガバナンスである。

AI開発のエネルギー強度を踏まえ、米モーニングスターの独自のスクリーニングでは、その企業が二酸化炭素排出量をどのように管理しているかが重要な考慮事項となる。

ビジネス倫理の管理については、知的財産、反競争的行為、非倫理的機会回避のためのインセンティブなど、問題に対する取締役会や経営陣の企業統治が考慮される。

製品ガバナンスMEIでは、顧客の期待とのミスマッチにつながり得るイノベーション管理不足といった問題を含む、製品安全性の複数の重要側面に重きが置かれる。

言うまでもなく、サステナリティクスの評価はAIだけに限定されるものではない。しかし、AI製品の成長が続く中、これらの重要ESG課題の管理に関わるベストプラクティスを実践している企業が最も良いポジションにあることは間違いないだろう。

Bing Chatが軽視した超重要リスク

Bing Chatが少し触れただけで説明が漏れた重要リスクがもう1つある。データプライバシーおよびセキュリティだ。自然言語処理のようなAIツールを利用する消費者が増えているため、個人を特定できるデータのプライバシーとセキュリティが最も重要になっている。

スマート家電がユーザーの検索履歴に基づいて興味を引く広告を表示する際にこの情報が利用されるのは許容範囲かもしれないが、アマゾンが子供の声を保存していることやアップルが将来のアルゴリズム開発のために人間の音声をテキスト変換していることは問題含みだろう。

プライバシーの問題は個人の枠に限ったことではない。2023年初め、サムソンのエンジニアがエラーチェックにツールを使用していたとき、誤って機密プログラミングコードをChatGPTに漏えいしてしまったことがあった。

アップルがSiriの会話を聞くための請負業者を雇わなくなったことを含め、AIプロバイダー各社は近年、こうした懸念の多くにしっかりと対処してきた。しかし、世界は急速に動いている。適切な管理制御が導入されていない企業は、イノベーションという大義名分のもと、個々のユーザーのプライバシーに関する懸念を避けて通りたい誘惑に駆られるかもしれない。

これまで述べてきたリスクは、現実世界に影響を及ぼす。筆者の同僚が2022年の記事で指摘したように、データ侵害のコストは増加の一途をたどっている。IBMとポニモン・インスティテュートの2023年最新のデータ侵害コストレポートによると、データ侵害1件あたりのコストは445万ドルに達し、2020年から15.3%増加しているという。規制当局は今後もこの分野への注視を継続するだろう。EUのAI規制法案では、データガバナンス条項に違反した企業は収益の最大4%の罰金を科される可能性がある。

責任あるAIの利用は利益をもたらす。IBMの同じ調査では、AIセキュリティ製品を利用している企業のデータ侵害の平均コストは20%近く低いことが示されている。しかし、多くの新たなテクノロジー同様、AIももろ刃の剣になり得る。この分野を重視する長期投資家にとっては、機会だけでなく、ESGの主要リスクを理解することが極めて重要になる。